Page 54 - 国外钢铁技术信息内参(2022年8月)

P. 54

ᇏݓࣁඋ࿐߶

差,梯度爆炸会导致神经网络不稳定,使梯度误差随着处理进程不断累积。因此,

当输入时滞超过 5~10 步后,传统 RNN 无法进行有效学习。

2000 年,Gers 等人引入了带有自适应遗忘门的 LSTM 模型,该模型能够清

理单元内存并捕获长期依赖。LSTM 具有最先进的语音识别、手写识别、语言建

模和翻译等方面性能。2014 年,Sak 等人发现 LSTM 网络在大型声学建模方面

比深度神经网络(DNN)更具优势。Sutskever 等人(2014 年)在通过语言建模

ᇏݓࣁඋ࿐߶

解决机器翻译问题的过程中应用了 LSTM 模型,其困惑度比标准递归网络语言

模型提高了 8%左右。 ᇏݓࣁඋ࿐߶

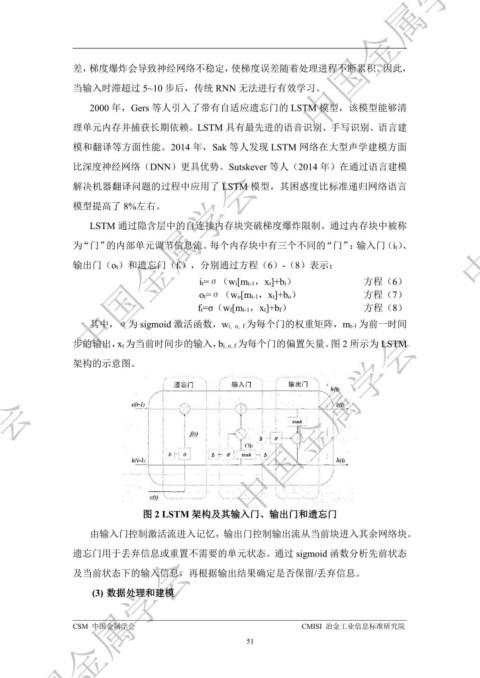

LSTM 通过隐含层中的自连接内存块突破梯度爆炸限制。通过内存块中被称

为“门”的内部单元调节信息流。每个内存块中有三个不同的“门”:输入门(it)、

输出门(ot)和遗忘门(ft),分别通过方程(6)-(8)表示:

it=σ(wi[mt-1,xt]+bi) 方程(6)

ot=σ(wo[mt-1,xt]+bo) 方程(7)

ft=σ(wf[mt-1,xt]+bf) 方程(8)

其中,σ为 sigmoid 激活函数,wi,o,f 为每个门的权重矩阵,mt-1 为前一时间

步的输出,xt 为当前时间步的输入,bi, o, f 为每个门的偏置矢量。图 2 所示为 LSTM

架构的示意图。 ᇏݓࣁඋ࿐߶

ᇏݓࣁඋ࿐߶

图 2 LSTM 架构及其输入门、输出门和遗忘门

由输入门控制激活流进入记忆,输出门控制输出流从当前块进入其余网络块。

遗忘门用于丢弃信息或重置不需要的单元状态。通过 sigmoid 函数分析先前状态

ᇏݓࣁඋ࿐߶

及当前状态下的输入信息,再根据输出结果确定是否保留/丢弃信息。

(3) 数据处理和建模

CSM 中国金属学会 CMISI 冶金工业信息标准研究院

51